iPhone X下Animoji表情怎么弄出来的?

自苹果iPhone X开始,越来越多的手机中都出现了一项新功能——人脸识别和定制表情(Animoji),使用者可以通过iPhone X的前置摄像头来捕捉人的脸部表情,即时转为手机可用的表情包。这个在iPhone X上很好玩的组件,操作起来也非常的简单。今天我们就来探讨一下这背后蕴藏什么样的技术,看看苹果通过什么技术手段来实现。

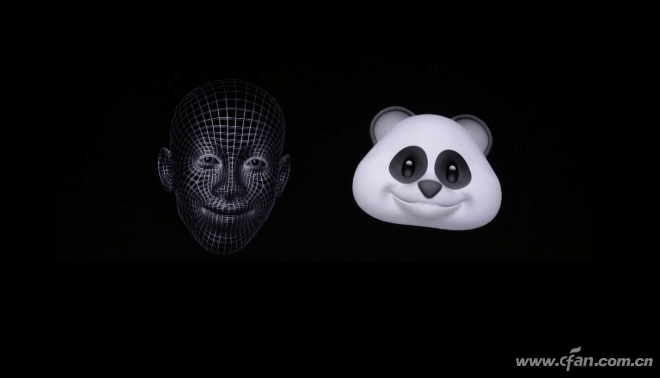

Animoji表情

Animoji,脸部表情是这样到手机的

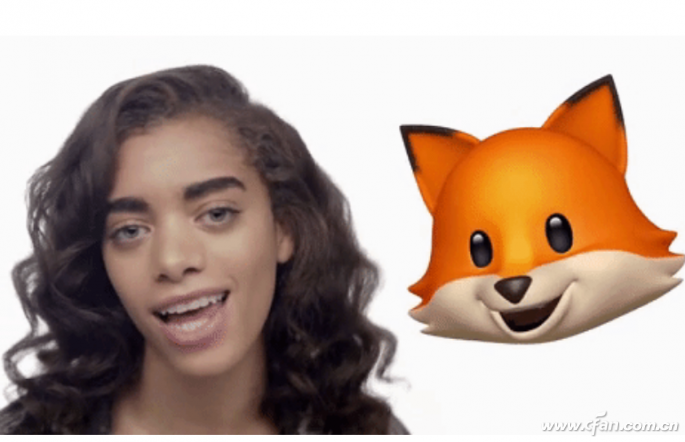

现在无论是聊天还是留言,发朋友圈,每个人几乎都在用各种表情包。iPhone X的Animoji功能则可以让每个用户的实时脸部表情转化为手机可用的表情包。在iPhone X上打开信息APP,选择3D表情图标。接着将自己的脸部放置于iPhone X的取景框中,然后开始录制并发送即可。iPhone X的前摄像头会自动捕捉到用户的脸部表情,通过这些面部信息,设备就可以让虚拟形象即时表现出和用户相似的表情来。

在iPhone X上使用Animoji功能

看似简单的背后——脸部追踪技术解读

Animoji这个看上去很简单的功能,背后的研发路程却颇为艰辛。因为大家知道每个人的脸部表情是非常丰富的,而且它不同于静态物体,人脸表情总是持续变化,因此没有一个普遍的运算法可以通用,算法的缺失导致机器很难有效捕捉并识别人脸表情。

在脸部动态追踪领域,为了可以有效捕捉到用户脸部数据,最早人们是通过在脸部添加标记点的方法实现。看过《阿凡达》的朋友都知道,该剧3D人物脸部有非常细腻逼真的表情,这个脸部表情追踪的幕后功臣就是贴在演员脸部的各种追踪传感器。这样当演员的面部表情发生变化时,这些传感器会感应到脸部这些变化,并将这些变化传输到光学系统中,捕捉系统收到这些变化的数据后会在电脑上建模并生成3D人物表情,这样才让《阿凡达》里的3D人物栩栩如生。

《阿凡达》拍摄现场演员脸部的各种追踪传感器

虽然使用传感器方法可以有效的实现对人脸部表情的追踪和捕捉,但是缺点也是显而易见的。首先是麻烦,在现实生活中我们不可能为了捕捉脸部表情而在用户脸上贴上各种追踪器,其次是投资大,我们需要在捕捉现场配备运动捕捉套件,工作站(用于3D建模)等配套设备。

那么如何在更低成本,更简单环境下实现脸部跟踪?苹果的Animoji功能就是一个脸部追踪技术在手机上的典型应用。为了让机器可以识别出面部运动,首先机器就必须看懂各种各样的面部表情。为此苹果工程师开发了一整套复杂的算法,通过一系列面部数据和表情数据,训练算法,让它们建立多个可以去描述的静态3D模型,同时借助人工智能技术自主学习来实现对面部表情的识别和建模。

Animoji中的3D建模

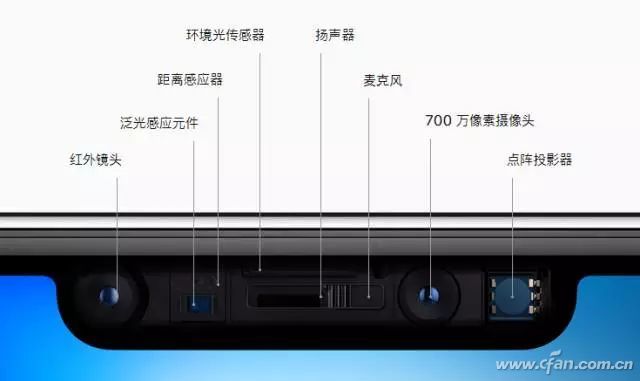

当然由于脸部表情和人种、环境光线、情绪等因素相关,因此这套算法捕捉到的信息里就包含上述这些差异信息。这样通过这些计算模型,再借助iPhone X集成的深度感应相机的长镜头,iPhone X捕捉扫描到的3D点阵面谱就能和实际的面部表情联系起来,从而实现了Animoji功能的应用。因此Animoji实际上是硬件(深度感应相机)和软件(iPhone X内置识别算法和人工智能技术)在脸部追踪技术上一个结合体。

iPhone X集成的深度感应相机系统

脸部追踪,不仅仅是好玩

随着iPhone X的发售,Animoji功能让很多果粉们觉得有趣、好玩。当然面部表情模仿仅仅是个开始,随着脸部追踪技术的发展和手机性能的提升。以后在我们手机上借助一张照片和摄像头,系统就可以打造出真实度极高的虚拟形象,甚至达到能让人误以为是真人在说话和做出表情的程度。想一想,以后在微信、QQ、彩信里,想发表情就直接使用自己实际脸部表情来给对方,这样聊天是不是更有趣?

Animoji可以实时捕捉人脸的面部表情

当然除了好玩外,其内部蕴含的脸部识别技术其实在我们的生活中还有很多的用处。比如Snapchat照片分享应用,它开发的面部匹配滤镜功能得到很多用户的喜爱。Snapchat支持了iPhone X的原深感系统后,借助iPhone X的脸部追踪技术,它能更精准的匹配面部表情,让用户在分享照片是得到更多的乐趣。当然类似的功能还可以在更多的生活场景中得到应用,比如在监控中对运动人脸的识别,通过人脸识别技术来快速找到特定人物等。